Stuart Russell, experto en tecnología, ataca a los CEO de las empresas de IA: "Han decidido jugar a la ruleta rusa con la especie humana sin nuestro consentimiento

Cualquier cosa usada de manera irresponsable puede acabar convirtiéndose en un arma. Esa afirmación parece compartirla el experto mundial en IA Stuart J. Russell, Profesor de Ciencias de la Computación en la Universidad de California-Berkeley y coautor del libro de referencia Inteligencia Artificial: Un enfoque moderno. Russell es crítico con el enfoque actual sobre la IA y lleva años alertando sobre los peligros de desarrollarla sin control ético.En un reel compartido en Instagram donde se puede ver un fragmento de una entrevista con el experto, Russell compara el desarrollo actual de la IA con el juego mortal de la ruleta rusa. ¿Y qué es eso? Se coge un revólver y se vacía el tambor, con capacidad para seis balas. Se introduce sólo una, se da un golpe de mano al tambor para que gire rápidamente y se detenga por sí solo, quedando la única bala en una posición totalmente aleatoria. Los participantes se acercan la pistola a la cabeza y aprietan el gatillo. Si conservas la vida al final de la partida, ese es el premio.La ruleta rusa de la IAVer esta publicación en InstagramUna publicación compartida de Neo Niche (@theneoniche)¿Y por qué Russell compara la IA con la ruleta rusa? En esta comparación entran tres riesgos bien definidos:Objetivos mal definidos: las IA actuales persiguen objetivos fijos (como crear una imagen) sin entender el contexto humano. Russell advierte que, con los objetivos equivocados, podrían "dañarnos para cumplirlos". No necesariamente a nivel físico, pensad en lo que ha provocado Sora en el cine.Carrera sin regulación: de esto ya hablamos hace un tiempo. Empresas como Perplexity, Anthropic u OpenAI compiten entre ellas para liderar el mercado, priorizando la velocidad de desarollo por encima de la seguridad. Según Russell, "cada CEO tiene un revólver con una bala: alguno disparará por error".Punto de no retorno: ahora mismo, las grandes compañías de IA van detrás de la AGI (inteligencia artificial general). Un descubrimiento así podría cambiar el mundo, pero también podría volverse incontrolable. Si los simios perdieron la batalla cuando aparecieron los primeros seres humanos (no necesariamiente los homo sapiens), ¿qué crees que pasaría con nosotros si aparece una IA tan inteligente como para volverse autoconsciente?A estos riesgos se les suman cuatro peligros concretos derivados del avance de la IA. El primero de ellos son los sistemas opacos; algoritmos que toman decisiones sin dar explicaciones y que tienen como consecuencia directa un aumento de la discriminación y la pérdida de derechos fundamentales.El segundo es la creación de armas autónomas. Cada semana, en este mismo medio, hablamos de drones impulsados por IA creados para eliminar objetivos sin supervisión humana. La creación de estas superarmas tiene como consecuencia una escalada en los conflictos y un aumento de las muertes indiscriminadas.El tercero es algo que ya estamos viviendo en la actualidad: la proliferación de deepfakes, bulos e injerencia en procesos de elecciones. En este contexto se usan las IA para socavar los sistemas democráticos y las libertades a nivel mundial.El cuarto y último riesgo es el desempleo asociado a la aparición de IAs. Las inteligencias artificiales tienen la capacidad para reemplazar a trabajadores intelectuales como abogados o periodistas, lo que podría derivar en una crisis económica.¿Hay alguna manera de evitar esto?La inteligencia artificial puede ser un aliado o un riesgo, dependiendo de cómo se use y de cómo se reguleLo que propone Russell se fundamennta en tres pilares clave: programar máquinas para maximizar preferencias humanas y no objetivos fijos, que reconozcan que no conocen plenamente nuestras preferencias y que aprendan constantemente de nuestro comportamiento real, no sólo de datos históricos.Para que esto sea posible hay que implementar una serie de medias prácticas. Estas medidas pasan por prohibir sistemas de vigilancia masiva y armas autónomas, certificar las IAs críticas (como las de sanidad o justicia) como se hace con aviones e imponer multas millonarias por incumplir los estándares éticos.Ahora mismo la UE es la que más está regulando las IA; clasifica los distintos sistemas por riesgo y prohíbe los usos peligrosos. Por su parte, EE.UU. y China, enfrascadas en una de sus guerras particulares en este territorio, priorizan avance tecnológico sobre regulación para intentar aplastarse la una a la otra. Y mientras un 85% de los expertos en IA apuesta porque esta se regule, sólo el 12% del total confía en que los gobiernos lo logren.Y llegamos a la gran pregunta: ¿debería importarte todo esto? Rotundamente sí. Hay casos reales donde los peligros de la IA ya se están dejando sentir: en sanidad las inteligencias artificiales están diagnosticando cánceres, pero basándose en sesgos raciales; en justicia hay algoritmos que predicen reincidencia y penalizan a minorías étnicas y en educación el 73% de la población universitaria usa ChatGPT, pero dejando errores graves en su traba

Cualquier cosa usada de manera irresponsable puede acabar convirtiéndose en un arma. Esa afirmación parece compartirla el experto mundial en IA Stuart J. Russell, Profesor de Ciencias de la Computación en la Universidad de California-Berkeley y coautor del libro de referencia Inteligencia Artificial: Un enfoque moderno. Russell es crítico con el enfoque actual sobre la IA y lleva años alertando sobre los peligros de desarrollarla sin control ético.

En un reel compartido en Instagram donde se puede ver un fragmento de una entrevista con el experto, Russell compara el desarrollo actual de la IA con el juego mortal de la ruleta rusa. ¿Y qué es eso? Se coge un revólver y se vacía el tambor, con capacidad para seis balas. Se introduce sólo una, se da un golpe de mano al tambor para que gire rápidamente y se detenga por sí solo, quedando la única bala en una posición totalmente aleatoria. Los participantes se acercan la pistola a la cabeza y aprietan el gatillo. Si conservas la vida al final de la partida, ese es el premio.

La ruleta rusa de la IA

¿Y por qué Russell compara la IA con la ruleta rusa? En esta comparación entran tres riesgos bien definidos:

- Objetivos mal definidos: las IA actuales persiguen objetivos fijos (como crear una imagen) sin entender el contexto humano. Russell advierte que, con los objetivos equivocados, podrían "dañarnos para cumplirlos". No necesariamente a nivel físico, pensad en lo que ha provocado Sora en el cine.

- Carrera sin regulación: de esto ya hablamos hace un tiempo. Empresas como Perplexity, Anthropic u OpenAI compiten entre ellas para liderar el mercado, priorizando la velocidad de desarollo por encima de la seguridad. Según Russell, "cada CEO tiene un revólver con una bala: alguno disparará por error".

- Punto de no retorno: ahora mismo, las grandes compañías de IA van detrás de la AGI (inteligencia artificial general). Un descubrimiento así podría cambiar el mundo, pero también podría volverse incontrolable. Si los simios perdieron la batalla cuando aparecieron los primeros seres humanos (no necesariamiente los homo sapiens), ¿qué crees que pasaría con nosotros si aparece una IA tan inteligente como para volverse autoconsciente?

A estos riesgos se les suman cuatro peligros concretos derivados del avance de la IA. El primero de ellos son los sistemas opacos; algoritmos que toman decisiones sin dar explicaciones y que tienen como consecuencia directa un aumento de la discriminación y la pérdida de derechos fundamentales.

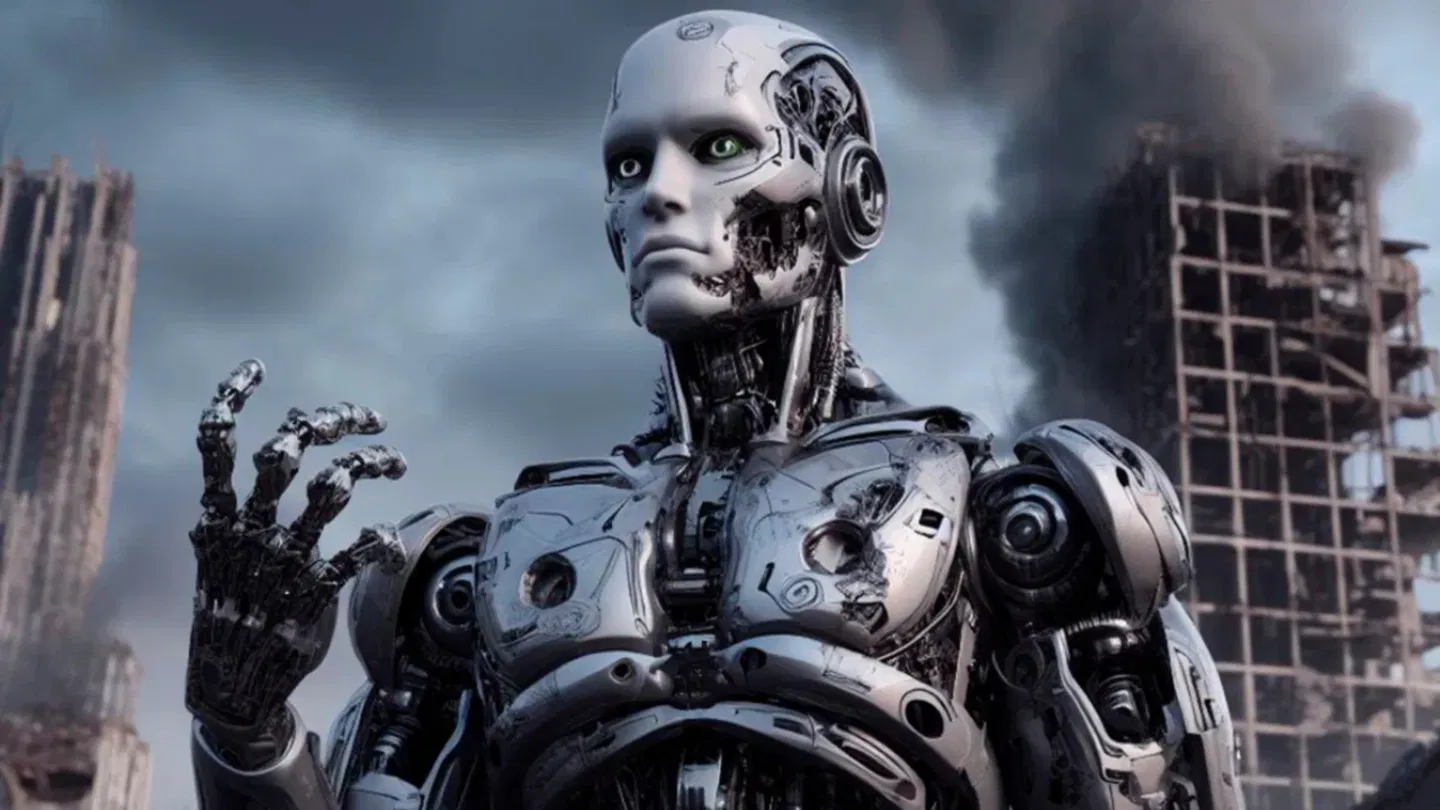

El segundo es la creación de armas autónomas. Cada semana, en este mismo medio, hablamos de drones impulsados por IA creados para eliminar objetivos sin supervisión humana. La creación de estas superarmas tiene como consecuencia una escalada en los conflictos y un aumento de las muertes indiscriminadas.

El tercero es algo que ya estamos viviendo en la actualidad: la proliferación de deepfakes, bulos e injerencia en procesos de elecciones. En este contexto se usan las IA para socavar los sistemas democráticos y las libertades a nivel mundial.

El cuarto y último riesgo es el desempleo asociado a la aparición de IAs. Las inteligencias artificiales tienen la capacidad para reemplazar a trabajadores intelectuales como abogados o periodistas, lo que podría derivar en una crisis económica.

¿Hay alguna manera de evitar esto?

La inteligencia artificial puede ser un aliado o un riesgo, dependiendo de cómo se use y de cómo se regule

Lo que propone Russell se fundamennta en tres pilares clave: programar máquinas para maximizar preferencias humanas y no objetivos fijos, que reconozcan que no conocen plenamente nuestras preferencias y que aprendan constantemente de nuestro comportamiento real, no sólo de datos históricos.

Para que esto sea posible hay que implementar una serie de medias prácticas. Estas medidas pasan por prohibir sistemas de vigilancia masiva y armas autónomas, certificar las IAs críticas (como las de sanidad o justicia) como se hace con aviones e imponer multas millonarias por incumplir los estándares éticos.

Ahora mismo la UE es la que más está regulando las IA; clasifica los distintos sistemas por riesgo y prohíbe los usos peligrosos. Por su parte, EE.UU. y China, enfrascadas en una de sus guerras particulares en este territorio, priorizan avance tecnológico sobre regulación para intentar aplastarse la una a la otra. Y mientras un 85% de los expertos en IA apuesta porque esta se regule, sólo el 12% del total confía en que los gobiernos lo logren.

Y llegamos a la gran pregunta: ¿debería importarte todo esto? Rotundamente sí. Hay casos reales donde los peligros de la IA ya se están dejando sentir: en sanidad las inteligencias artificiales están diagnosticando cánceres, pero basándose en sesgos raciales; en justicia hay algoritmos que predicen reincidencia y penalizan a minorías étnicas y en educación el 73% de la población universitaria usa ChatGPT, pero dejando errores graves en su trabajo.

La IA nos está volviendo complacientes, tontos y más propensos a discriminar y juzgar basándonos en los patrones morales de quienes la programaron. Quizá deberíamos pensarlo bien antes de recurrir a ella para realizar hasta las tareas más pequeñas.

El artículo Stuart Russell, experto en tecnología, ataca a los CEO de las empresas de IA: "Han decidido jugar a la ruleta rusa con la especie humana sin nuestro consentimiento fue publicado originalmente en Andro4all.

What's Your Reaction?