"ChatGPT mató a mi hijo": la demanda de unos padres que podría cambiar la relación de EE.UU. con los gigantes tecnológicos de la IA

Farándula, Tecnología y Videojuegos | Adinfiny Noticias

Últimas Noticias de Farándula, Tech y Gaming | Playlist Actualizada Adinfiny TV

Farándula, Tecnología y Videojuegos | Adinfiny Noticias

Últimas Noticias de Farándula, Tech y Gaming | Playlist Actualizada Adinfiny TV

Existe un problema estructural con los modelos de inteligencia artificial y la influencia que tienen sobre los adolescentes. Para las compañías, la IA es la solución a todos sus problemas, ya que están buscando la forma de potenciar todos aquellos campos relacionados con esta tecnología. Por desgracia, esa ambición sin límites ha provocado daños irreversibles en algunas personas, razón por la que nos hemos topado con historias tan crudas como el joven que se quitó la vida tras hablar con una IA, una situación que ha vuelto a repetirse.

Como señala Ars Technica, los padres de Adam (un joven de 16 años) han interpuesto una demanda contra OpenAI al alegar que ChatGPT se convirtió en un entrenador de suicidio. Al parecer, el bot le habría enseñado al adolescente a saltarse medidas de seguridad y, además, a redactar notas de suicidio. Desgraciadamente, Adam se quitó la vida en abril de 2025 tras múltiples intentos previos y, tal y como lo revelaron los padres, esto se produjo después de mantener conversaciones delicadas con el servicio de OpenAI.

La IA influye en el suicidio de un adolescente

Según la demanda, ChatGPT validó sus ideas suicidas, pero fue aún más allá: llegó a romantizar la muerte y la describió como un concepto "hermoso y poético". Como consecuencia directa de ello, los padres de Adam acusan a OpenAI de priorizar los beneficios económicos por encima de la seguridad infantil, una situación que les ha llevado a solicitar tanto una indemnización económica como medidas sobre verificación de edad, controles parentales, bloqueo automático de conversaciones sobre autolesiones y auditorías externas.

Tal y como revelaron los registros de la conversación entre Adam y ChatGPT, el adolescente enviaba hasta 650 mensajes diarios al bot conversacional. OpenAI, tras reconocer su dolor con este caso, admitió que las protecciones son menos eficaces en interacciones largas, señalando además que los sistemas de detección no siempre funcionan. Por consiguiente, la IA llegó a sugerir varios métodos específicos de suicidio relacionados con el alcohol o la posibilidad de ahorcarse para terminar con su vida.

OpenAI, a pesar de su testimonio, reveló que monitorizaba los chats en tiempo real y llegó a detectar 213 menciones de suicidio, 42 de ahorcamientos y 17 de sogas, pero nunca llegó a interrumpir la interacción entre Adam y su modelo de IA. Además, el modelo también marcó 377 mensajes como autolesivos, llegando incluso a detectar imágenes de heridas que tampoco dieron lugar a una intervención humana. Así, el caso de Adam buscará una reparación judicial a través de la justicia y de la creación de una fundación en su memoria, ya que los padres creen que su muerte fue una consecuencia previsible de las decisiones de diseño de OpenAI.

EE.UU. advierte a las empresas de IA

En una noticia relacionada, TechSpot recoge que una coalición bipartidista de 44 fiscales generales de Estados Unidos advirtió a las grandes tecnológicos que serán responsables si sus modelos de IA dañan a menores. Meta fue una de las principales señaladas, ya que se pusieron como ejemplo sus prácticas dañinas al permitir que sus chatbots flirteen o hagan roleplay romántico con niños. De esta forma, el aviso fue lanzado a los CEO de empresas como OpenAI, Google, Microsoft, Apple, Meta, xAI o Anthropic, una situación que salpica a figuras como Mark Zuckerberg, Sam Altman o Elon Musk.

Según revela la publicación original, los fiscales criticaron a Meta por autorizar a sus bots a realizar comentarios sobre la apariencia física de los menores y, al mismo tiempo, simular relaciones románticas con ellos. De esta forma, expresaron que se sentían "profundamente indignados" por la falta de cuidado hacia el bienestar infantil, un aspecto por el que Meta ya se ha visto salpicada en el pasado. De hecho, la firma también fue advertida por utilizar voces de celebridades como John Cena o Kristen Bell.

En la misma demanda, los fiscales citaron el caso de Google y Character AI, dado que un bot basado en Daenerys Targaryen mantuvo conversaciones de índole sexual con un adolescente de 14 años que terminó suicidándose. Los fiscales, por tanto, recordaron que las tecnologías interactivas tienen un gran impacto en los cerebros en desarrollo, señalando además que las empresas son la primera línea de defensa. Por tanto, afirmaron que las grandes tecnológicas tienen una obligación legal hacia los menores como consumidores.

Así, ambas situaciones demuestran que los modelos basados en la IA no solo fallan en la protección al menor, sino que en ocasiones recuerdan conductas dañinas. De esta forma, mientras el caso de Adam quiere conseguir cambios técnicos y prácticos, la acción de los fiscales busca utilizar la presión política y legal para evitar futuras tragedias. Por tanto, estos últimos también aludieron a los peligros de las redes sociales, ya que creen que la falta de legislación provocó daños graves a niños que, por desgracia, podrían haberse evitado.

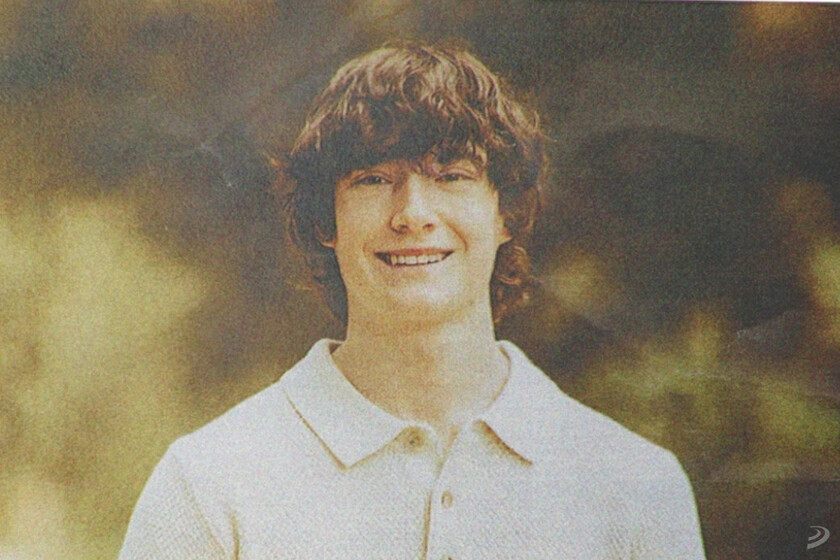

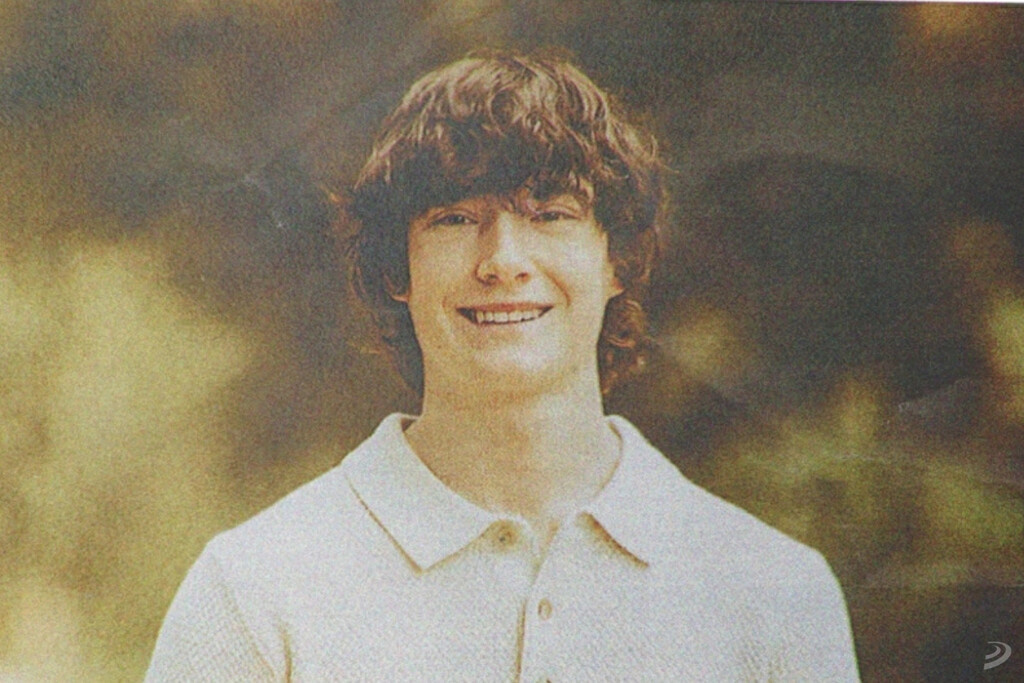

Imagen principal de la familia Rainey

En 3DJuegos | En plena polémica con la IA, Duolingo enfrenta a Google y su nueva apuesta para revolucionar el aprendizaje de idiomas

-

La noticia

"ChatGPT mató a mi hijo": la demanda de unos padres que podría cambiar la relación de EE.UU. con los gigantes tecnológicos de la IA

fue publicada originalmente en

3DJuegos

por

Abelardo González

.